현재까지 얼굴 매력도 예측(FAP)은 주로 심리학 연구, 미용 및 화장품 산업, 성형외과 분야에서 연구되어 왔습니다. 아름다움의 기준은 다음과 같은 경향이 있기 때문에 이는 도전적인 연구 분야입니다. 글로벌이 아닌 국내.

이는 모든 문화권의 얼굴/평가를 샘플링하여 얻은 평균 평균이 매우 편향되어(인구가 많은 국가가 추가 견인력을 얻을 수 있는 경우), 효과적인 단일 AI 기반 데이터 세트가 실행 가능하지 않음을 의미합니다. 문화가 전혀 없어요 (여기서 여러 종족/등급의 평균 평균은 실제 종족이 없는 것과 같습니다).

대신, 개발하는 것이 과제입니다. 개념적 방법론 효과적인 지역별 FAP 모델 개발을 가능하게 하기 위해 국가 또는 문화별 데이터를 처리할 수 있는 워크플로우.

미용 및 심리학 연구에서 FAP의 사용 사례는 산업별로 매우 미미합니다. 따라서 현재까지 선별된 대부분의 데이터 세트에는 제한된 데이터만 포함되어 있거나 전혀 게시되지 않았습니다.

주로 서구 청중을 대상으로 하는 온라인 매력도 예측 변수의 용이한 가용성은 현재 동아시아 연구(주로 중국) 및 해당 동아시아 데이터 세트가 지배하는 것으로 보이는 FAP의 최첨단을 반드시 대표하지는 않습니다.

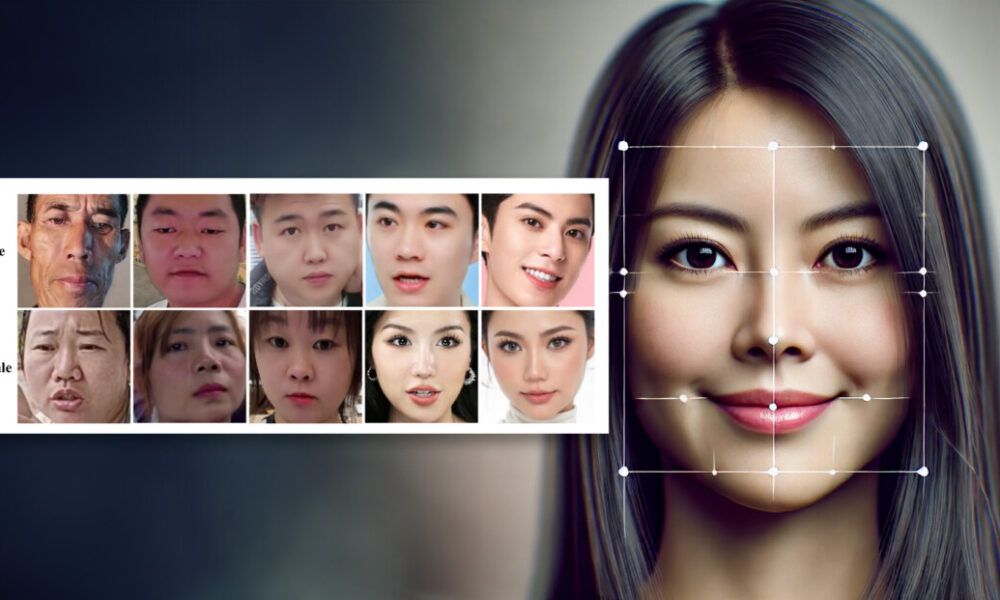

2020년 논문 ‘전이 학습 및 다중 채널 기능 융합을 통한 심층 신경망을 사용한 아시아 여성 얼굴 미용 예측’의 데이터세트 예시입니다. 출처: https://www.semanticscholar.org/paper/Asian- Female-Facial-Beauty-Prediction-Using-Deep-Zhai-Huang/59776a6fb0642de5338a3dd9bac112194906bf30

아름다움 추정을 위한 보다 광범위한 상업적 용도는 다음과 같습니다. 온라인 데이트 앱그리고 생성적 AI 시스템은 다음과 같이 설계되었습니다. 사람들의 실제 아바타 이미지 ‘터치업’ (이러한 응용 프로그램에는 효과의 척도로서 아름다움에 대한 양자화된 표준이 필요했기 때문입니다).

얼굴 그리기

매력적인 개인은 계속해서 광고 및 영향력 구축에서 귀중한 자산이 되어 이러한 부문의 재정적 인센티브를 최첨단 FAP 데이터 세트 및 프레임워크를 발전시킬 수 있는 확실한 기회로 만듭니다.

예를 들어, 얼굴의 아름다움을 평가하고 평가하기 위해 실제 데이터로 훈련된 AI 모델은 잠재적으로 광고 영향을 미칠 가능성이 높은 사건이나 개인을 식별할 수 있습니다. 이 기능은 현재 ‘팔로워’ 및 ‘좋아요’와 같은 지표가 현재로서만 역할을 하는 라이브 비디오 스트리밍 컨텍스트와 관련이 있습니다. 절대적인 청중을 사로잡는 개인(또는 심지어 얼굴 유형)의 능력을 나타내는 지표입니다.

물론 이는 피상적인 척도일 뿐이며 음성, 프레젠테이션, 관점 역시 청중을 모으는 데 중요한 역할을 합니다. 따라서 FAP 데이터세트의 큐레이션에는 사람의 감독뿐만 아니라 얼굴 매력과 ‘특이한’ 매력을 구별하는 능력이 필요합니다(이것이 없으면 Alex Jones와 같은 도메인 외부 영향력자는 결국 단독으로 설계된 컬렉션의 평균 FAP 곡선에 영향을 미칠 수 있음). 얼굴의 아름다움을 평가하기 위해).

라이브뷰티

FAP 데이터세트의 부족 문제를 해결하기 위해 중국 연구자들은 얼굴 아름다움을 추정하는 200,000개의 인간 주석과 함께 100,000개의 얼굴 이미지가 포함된 최초의 대규모 FAP 데이터세트를 제공하고 있습니다.

새로운 LiveBeauty 데이터 세트의 샘플. 출처: https://arxiv.org/pdf/2501.02509

자격 있음 라이브뷰티데이터 세트에는 2024년 3월에 (지정되지 않은) 라이브 스트리밍 플랫폼에서 캡처된 10,000개의 다양한 ID가 포함되어 있습니다.

저자는 또한 새로운 다중 모드 FAP 방법인 FPEM을 제시합니다. FPEM은 전체적인 얼굴 사전 지식과 다중 모드 미적 의미를 통합합니다. 특징 PAPM(개인화된 매력 우선 모듈), MAEM(다중 모드 매력 인코더 모듈) 및 CMFM(교차 모드 융합 모듈)을 통해.

이 논문에서는 FPEM이 새로운 LiveBeauty 데이터 세트 및 기타 FAP 데이터 세트에서 최첨단 성능을 달성했다고 주장합니다. 저자는 이 연구가 라이브 스트리밍에서 비디오 품질, 콘텐츠 추천 및 얼굴 리터칭을 향상시키는 데 잠재적으로 응용될 수 있다고 지적합니다.

저자는 또한 데이터 세트를 ‘곧’ 사용할 수 있도록 약속합니다. 하지만 소스 도메인에 내재된 라이센스 제한은 해당 작업을 활용할 수 있는 대부분의 적용 가능한 프로젝트에 전달될 가능성이 있다는 점을 인정해야 합니다.

그만큼 새 종이 제목이 붙어있다 라이브 스트리밍의 얼굴 매력도 예측: 새로운 벤치마크 및 다중 모드 방법Alibaba Group 및 Shanghai Jiao Tong University의 연구원 10명으로 구성되어 있습니다.

방법 및 데이터

연구자들은 라이브 스트리밍 플랫폼의 10시간 방송마다 처음 3시간 동안 시간당 하나의 이미지를 추출했습니다. 페이지 조회수가 가장 높은 방송을 선택했습니다.

수집된 데이터는 여러 전처리 단계를 거쳤습니다. 그 중 첫 번째는 얼굴 부위 크기 측정2018 CPU 기반을 사용하는 페이스박스 얼굴 윤곽 주위에 경계 상자를 생성하는 감지 모델입니다. 파이프라인은 경계 상자의 짧은 면이 90픽셀을 초과하도록 보장하여 작거나 불분명한 얼굴 영역을 방지합니다.

두 번째 단계는 흐림 감지이는 의 분산을 이용하여 얼굴 영역에 적용됩니다. 라플라시안 연산자 얼굴 자르기의 높이(Y) 채널에 있습니다. 이 분산은 10보다 커야 하며, 이는 흐릿한 이미지를 필터링하는 데 도움이 됩니다.

세 번째 단계는 얼굴 자세 추정2021을 사용합니다. 3DDFA-V2 포즈 추정 모델:

3DDFA-V2 추정 모델의 예. 출처: https://arxiv.org/pdf/2009.09960

여기서 워크플로는 잘린 얼굴의 피치 각도가 20도를 넘지 않고 요 각도가 15도를 넘지 않도록 보장합니다. 즉, 극단적인 포즈를 취하는 얼굴은 제외됩니다.

네 번째 단계는 얼굴 비율 평가는 또한 3DDFA-V2 모델의 분할 기능을 사용하여 얼굴이 두드러지지 않는 이미지를 제외하고 잘린 얼굴 영역 비율이 이미지의 60%보다 큰지 확인합니다. 즉, 전체 그림에서 작습니다.

마지막으로 다섯번째 단계는 중복 문자 제거10시간 분량의 동영상을 위해 수집된 3개의 이미지 중 2개 이상에 동일한 신원이 나타나는 경우를 위해 (귀속되지 않은) 최첨단 얼굴 인식 모델을 사용합니다.

사람의 평가 및 주석

사용된 라이브 플랫폼의 인구통계를 반영하여 6명의 남성과 14명의 여성으로 구성된 20명의 주석자가 모집되었습니다*. 일관된 실험실 조건에서 iPhone 14 Pro Max의 6.7인치 화면에 얼굴이 표시되었습니다.

평가는 200개의 세션으로 나누어 이루어졌으며 각 세션에는 50개의 이미지가 사용되었습니다. 피험자들은 각 세션 사이에 5분의 휴식 시간을 두고 샘플의 얼굴 매력을 1~5점으로 평가하도록 요청받았으며, 모든 피험자는 모든 세션에 참여했습니다.

따라서 10,000개의 이미지 전체를 20명의 인간 피험자에 대해 평가하여 200,000개의 주석에 도달했습니다.

분석 및 전처리

먼저, 이상치 비율(outlier ratio)과 Spearman의 순위 상관 계수 (SROCC). SROCC 등급이 0.75 미만이거나 국외자 2%를 초과하는 비율은 신뢰할 수 없는 것으로 간주되어 제거되었으며 최종적으로 20명의 대상자가 획득되었습니다.

그런 다음 유효한 피험자가 얻은 점수를 평균하여 각 얼굴 이미지에 대해 평균 의견 점수(MOS)를 계산했습니다. MOS는 다음과 같은 역할을 합니다. 근거 진실 각 이미지에 매력도 라벨을 부여하고, 유효한 각 대상의 모든 개별 점수를 평균하여 점수를 계산합니다.

마지막으로, 모든 표본과 여성 및 남성 표본에 대한 MOS 분포를 분석한 결과, 가우스 스타일 모양이는 실제 얼굴 매력 분포와 일치합니다.

LiveBeauty MOS 배포의 예.

대부분의 개인은 평균적인 얼굴 매력을 갖는 경향이 있으며, 매력이 매우 낮거나 매우 높은 극단의 개인은 적습니다.

또한, 분석 왜도와 첨도 값은 분포가 얇은 꼬리로 특징 지어지고 평균 점수 주위에 집중되어 있음을 보여주었습니다. 높은 매력은 여성 표본에서 더 많이 나타남 수집된 라이브 스트리밍 영상에서

건축학

FPEM(Facial Prior Enhanced Multi-modal Model) 및 LiveBeauty의 하이브리드 융합 단계에 2단계 훈련 전략이 사용되었으며 PAPM(Personalized Charmness Prior Module), 다중 모드 매력 인코더 모듈( MAEM), CMFM(Cross-Modal Fusion Module) 및 DFM(Decision Fusion Module)이 있습니다.

LiveBeauty의 학습 파이프라인에 대한 개념적 스키마.

PAPM 모듈은 이미지를 입력으로 사용하고 스윈 트랜스포머또한 사전 학습된 얼굴 인식 특징을 추출합니다. 페이스넷 모델. 그런 다음 이러한 기능은 다음을 사용하여 결합됩니다. 교차주의 블록을 만들어 개인화된 ‘매력’ 기능을 만들어 보세요.

또한 예비 훈련 단계에서 MAEM은 매력에 대한 이미지와 텍스트 설명을 사용합니다. 클립 다중 모드의 미적 의미론적 특징을 추출합니다.

템플릿 텍스트 설명은 다음과 같은 형식입니다. ‘{a} 매력을 지닌 사람의 사진’ (어디 {에이} 될 수 있다 나쁜, 가난한, 공정한, 좋은 또는 완벽한). 프로세스는 다음을 추정합니다. 코사인 유사성 매력도 수준 확률에 도달하기 위해 텍스트 임베딩과 시각적 임베딩 사이를 이동합니다.

하이브리드 융합 단계에서 CMFM은 PAPM에서 생성된 개인화된 매력 기능을 사용하여 텍스트 임베딩을 개선하여 개인화된 텍스트 임베딩을 생성합니다. 그런 다음 유사성 회귀 예측을 하기 위한 전략.

마지막으로 DFM은 PAPM, MAEM 및 CMFM의 개별 예측을 결합하여 견고한 합의를 달성한다는 목표로 단일 최종 매력 점수를 생성합니다.

손실 함수

을 위한 손실 측정항목PAPM은 다음을 사용하여 훈련됩니다. L1 손실a는 예측된 매력도 점수와 실제(실측) 매력도 점수 사이의 절대적인 차이를 측정한 것입니다.

MAEM 모듈은 LS(스코어링 손실)와 LR(병합 순위 손실)을 결합하는 보다 복잡한 손실 함수를 사용합니다. 순위 손실(LR)은 충실도 손실(LR1)과 양방향 순위 손실 (LR2).

LR1은 이미지 쌍의 상대적 매력을 비교하는 반면, LR2는 매력 수준의 예측 확률 분포가 단일 피크를 가지며 양방향으로 감소하도록 보장합니다. 이러한 결합된 접근 방식은 매력을 기반으로 이미지의 정확한 채점과 올바른 순위를 모두 최적화하는 것을 목표로 합니다.[1965년9091]CMFM과 DFM은 간단한 L1 손실을 사용하여 학습됩니다.

테스트

테스트에서 연구원들은 LiveBeauty를 9가지 이전 접근 방식과 비교했습니다. 콤보넷; 2D-FAP; REX-INCEPT; CNN-ER(REX-INCEP에 포함); ME뷰티; AVA-MLSP; 타넷; 델레-트랜스; 그리고 먹다.

다음을 준수하는 기본 방법 이미지 미적 평가 (IAA) 프로토콜도 테스트되었습니다. 이것들은 ViT-B; ResNeXt-50; 그리고 인셉션-V3.

LiveBeauty 외에도 테스트된 다른 데이터세트는 다음과 같습니다. SHIELD-FBP5000 그리고 ME뷰티. 아래에서는 이러한 데이터 세트의 MOS 분포를 비교합니다.

벤치마크 데이터세트의 MOS 분포.

각각, 이러한 게스트 데이터 세트는 나뉘다 원래 프로토콜과의 일관성을 유지하기 위해 별도로 훈련 및 테스트용으로 60%-40% 및 80%-20%를 사용합니다. LiveBeauty는 90%-10% 기준으로 분할되었습니다.

MAEM의 모델 초기화를 위해 VT-B/16 및 GPT-2가 각각 이미지 및 텍스트 인코더로 사용되었으며 CLIP의 설정에 의해 초기화되었습니다. PAPM의 경우 Swin-T가 훈련 가능한 이미지 인코더로 사용되었습니다. 스윈페이스.

그만큼 아담W 옵티마이저가 사용되었고, 학습률 스케줄러 로 설정 선형 워밍업 아래에 코사인 어닐링 계획. 학습률은 훈련 단계에 따라 달랐지만 각 단계에는 배치 크기 32개 중 50개 시대.

테스트 결과

세 가지 FAP 데이터 세트에 대한 테스트 결과가 위에 나와 있습니다. 이러한 결과에 대해 논문에서는 다음과 같이 말합니다.

‘우리가 제안한 방법은 LiveBeauty, MEBeauty 및 SCUT-FBP5500의 SROCC 값에서 각각 약 0.012, 0.081, 0.021만큼 1위를 달성하고 2위를 능가하여 제안 방법의 우수성을 입증합니다.

‘[The] IAA 방법은 FAP 방법보다 열등하며, 이는 일반적인 미적 평가 방법이 얼굴 매력의 주관적 특성과 관련된 얼굴 특징을 간과하여 FAP 작업 성능이 저하된다는 것을 나타냅니다.

‘[The] MEBeauty에서는 모든 방법의 성능이 크게 저하됩니다. 이는 훈련 샘플이 제한되어 있고 MEBeauty의 얼굴이 인종적으로 다양하기 때문입니다. 이는 얼굴 매력에 큰 다양성이 있음을 나타냅니다.

‘이러한 모든 요인으로 인해 MEBeauty의 얼굴 매력 예측이 더욱 어려워졌습니다.’

윤리적 고려사항

매력에 대한 연구는 잠재적으로 분열적인 추구입니다. 왜냐하면 아마도 경험적 아름다움의 기준을 확립할 때 그러한 시스템은 나이, 인종 및 인간과 관련된 컴퓨터 비전 연구의 다른 많은 부분에 대한 편견을 강화하는 경향이 있기 때문입니다.

FAP 시스템은 본질적으로 경향이 있는 매력에 대한 부분적이고 편향된 관점을 강화하고 영속시키는 것입니다. 이러한 판단은 사람이 주도하는 주석(종종 효과적인 도메인 일반화를 위해 너무 제한된 규모로 수행됨)이나 능력주의와는 거리가 먼 스트리밍 플랫폼과 같은 온라인 환경의 주의 패턴 분석에서 발생할 수 있습니다.

* 이 논문은 단수형과 복수형 모두에서 이름이 지정되지 않은 소스 도메인을 언급합니다.

2025년 1월 8일 수요일 첫 게시

게시물 라이브 스트리밍을 위한 얼굴 매력 예측 처음 등장한 Unite.AI.